部署OpenClaw并免费使用AI大模型

OpenClaw介绍

随着OpenClaw在开源社区的爆火,也是越来越多的人开始尝鲜,我也不例外,经过一段时间的折腾,大概已经能掌握运用的方法了。搭建OpenClaw本身并不难,但是OpenClaw消耗token的速度实在吃不消,还好我找到了一个白嫖的方案可以免费使用多种AI大模型

openclaw也有网友叫大龙虾的,它是一个开源的AI代理与自动化工具,你可以把它想象成一个智能体的“操作系统”或“调度中心”。它本身不具备大模型的推理能力,而是作为“中介”,接收你的自然语言指令,理解你的意图,然后调度各种“技能”去调用不同的模型、操作你的设备或连接外部应用来完成任务。因为它的易用性,让非技术用户也能指挥AI完成一系列复杂自动化的任务,这也正是它爆火的原因

但是也不是没有缺点,因为它“越用越聪明”的特性会导致token消耗得特别快,可能跑一个简单的小型任务几百万token就没了,还好Nvidia开放了免费的开源AI大模型供大家使用,用于个人使用完全足够

openclaw可能不一定是AI这条路上的成功者,它是AI发展史上一个极具代表性的现象级产品,让人们对刷新了对AI的认知,点燃了人们对AI Agent时代的热情

部署OpenClaw

你可以部署在云端或者在电脑本地(不推荐),博主更推荐使用云服务器一键部署的方案,因为本地部署经常会因为在环境部署上出现问题,并且openclaw的权限很高,部署在本地非常的不安全,如果一定要在本地部署,那么也最好是在Docker容器里部署。使用云服务器就简单了,厂商直接提供openclaw的应用镜像,一键部署后把大模型和通讯app接入就可以马上使用了

如果想要本地部署请看官方文档https://docs.openclaw.ai/zh-CN

#macOS/Linux一键安装命令

curl -fsSL https://openclaw.ai/install.sh | bash

#Windows一键安装命令

iwr -useb https://openclaw.ai/install.ps1 | iex云服务器部署

国内主流厂商都提供openclaw的应用镜像,使用新用户账号购买的话大概60元左右就可以买一年的2C2G服务器,用来跑openclaw足够了,并且可以让它24小时不间断运行,下面两家大厂可以自行选择

服务器选择2C2G的就好,新用户一般都是可以60元左右拿下,老用户也有99元一年的产品,部署方式都是一样的,如果你想用国外的大模型那服务器地域就选择国外就好,如果你只是想用国内的大模型那就把地域选为国内这样调用速度快些,镜像都是直接选择OpenClaw的应用镜像,然后直接下一步等待初始化完成就好了,以阿里云为例,界面如下

配置大模型

阿里云和腾讯云都提供可视化的模型配置界面,可以很方便配置,配置模型就三个重要的内容

- Base URL:这是大模型的调用地址,格式为

https://大模型网站.com/v1 - API Key:这是大模型厂商分配给你的一把钥匙,用于验证你的身份

- model:模型的ID,也就是你需要引用的模型的名字

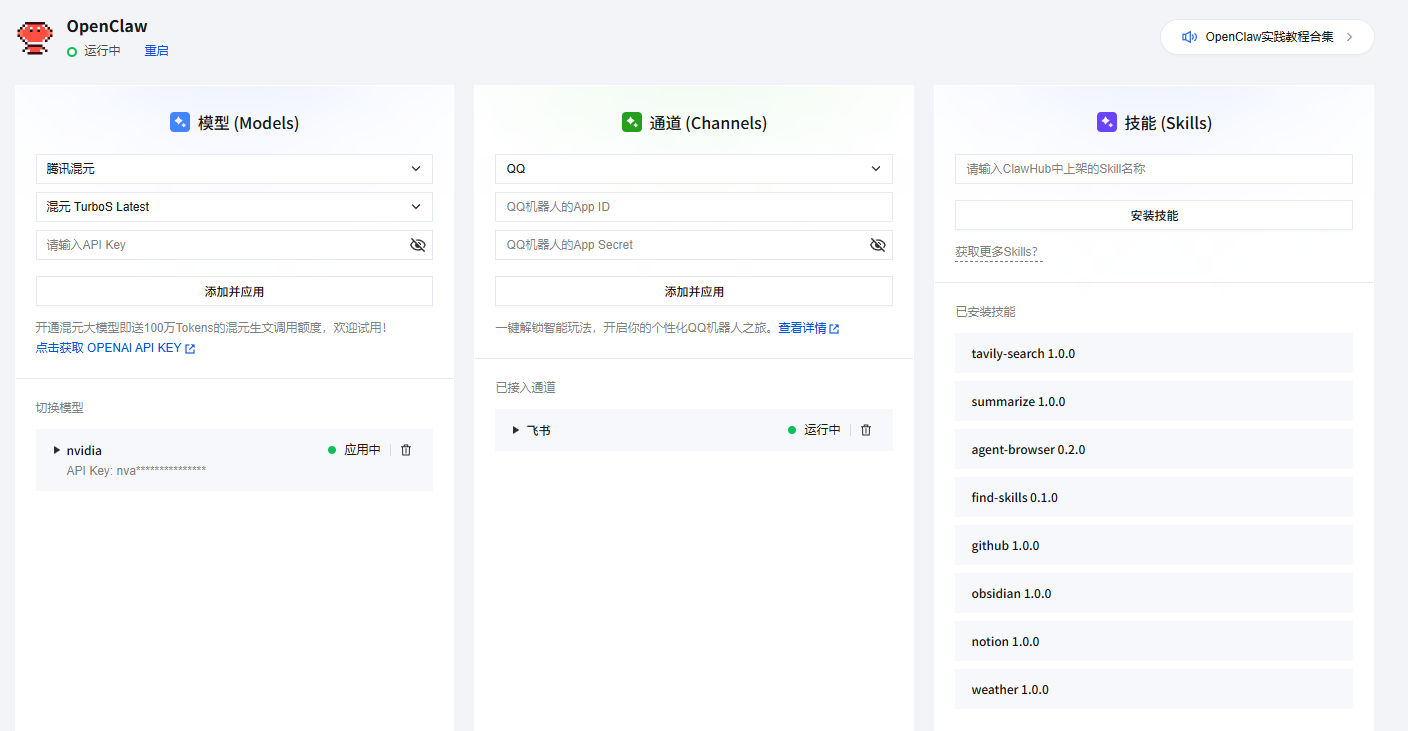

以腾讯云的openclaw为例子,后台配置如下

然后你的openclaw就配置完成了,使用厂商给的webui访问网页界面或者服务器命令输入openclaw tui进入tui界面都可以正常对话了

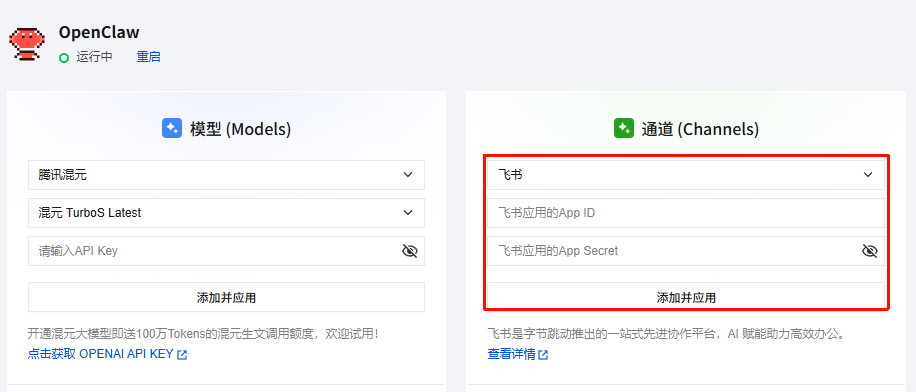

配置通信通道

还是需要一个通信通道才能更好的使用我们的openclaw,国内推荐使用飞书,一个月1万次api调用次数足够个人使用了,阿里和腾讯都支持可视化添加通信通道,我们只需要把通道所需要配置填到后台即可,我以飞书为例

首先打开飞书开放平台并登录https://open.feishu.cn/ 然后进入开发者后台

点击创建企业自建应用,为你的机器人取一个名字并选择图标创建

左侧导航栏中找到并点击添加应用能力,在弹出的列表中选择机器人,点击添加

在左侧导航栏找到凭据与基础信息,找到 App ID和 App Secret两个参数

服务器后台将App ID和 App Secret 填入飞书通道的配置里,下面以腾讯openclaw后台为例

保存之后再飞书左边导航栏找到事件与回调,事件配置那里选择使用长连接,然后保存

点击事件配置页面中的 添加事件,在弹出的列表中,搜索并添加 接收消息,点击 确认添加按照指引确认开通权限

在飞书应用管理页,左侧导航栏找到 权限管理,点击进入页面。点击页面中的 批量导入权限按钮,把下面的数据复制粘贴在框中然后点击确认新增权限即可

{

"scopes": {

"tenant": [

"im:message",

"im:message.p2p_msg:readonly",

"im:message.group_at_msg:readonly",

"im:message:send_as_bot",

"im:resource",

"contact:user.base:readonly",

"im:message.group_msg",

"im:message:readonly",

"im:message:update",

"im:message:recall",

"im:message.reactions:read",

"docx:document:readonly",

"drive:drive:readonly",

"wiki:wiki:readonly",

"bitable:app:readonly",

"task:task:read",

"contact:contact.base:readonly",

"docx:document",

"docx:document.block:convert",

"drive:drive",

"wiki:wiki",

"bitable:app",

"task:task:write"

],

"user": []

}

}在飞书应用管理页,左侧导航栏找到版本管理与发布 ,点击进入页面。点击右上角的创建版本填写应用版本号(此处以1.0.0为例,您可以自行定义版本号)和更新说明,点击保存并确认发布

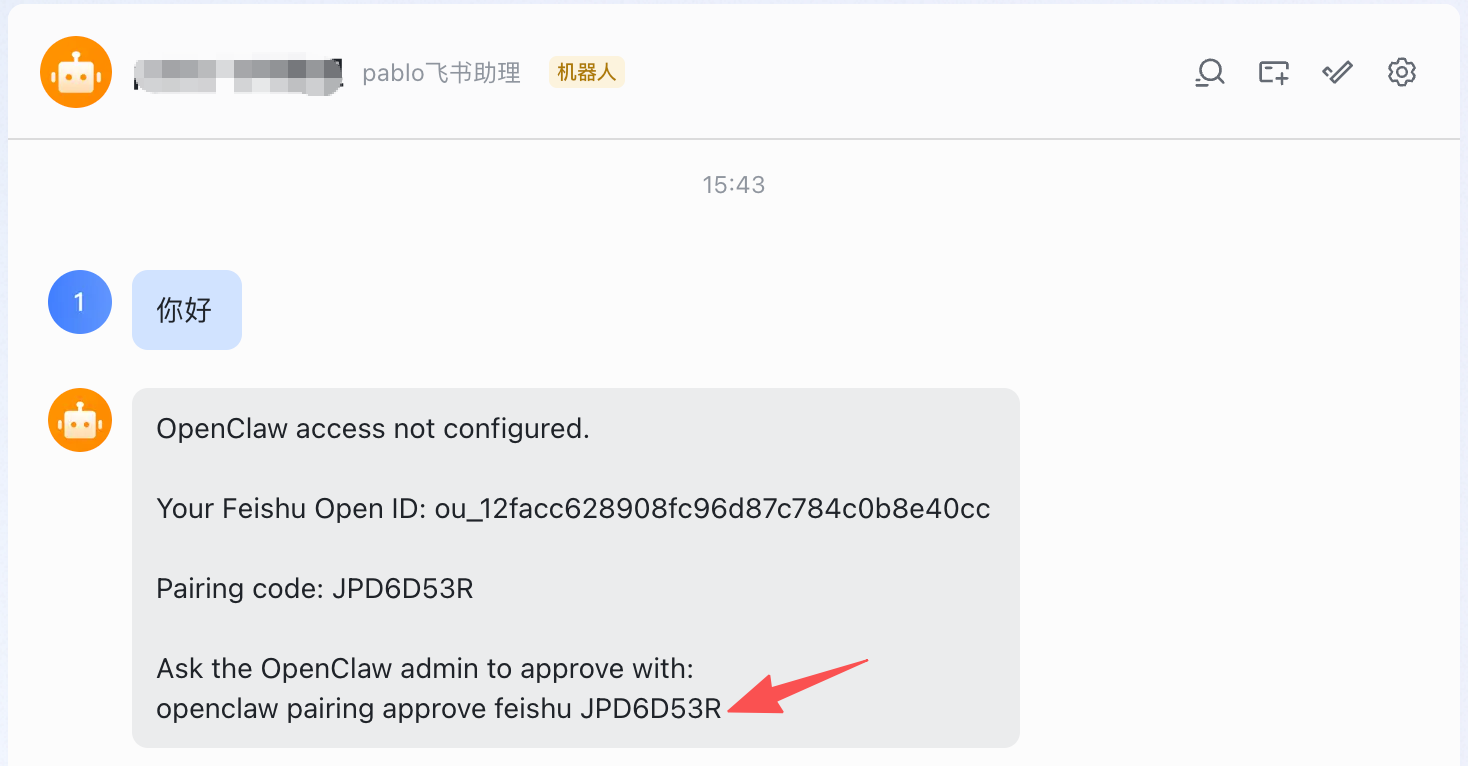

然后在飞书平台搜索刚创建的机器人,然后对话获取口令,首次对话会如果提示如下图所示的配对请求,可以复制机器人回复的最后一行命令行

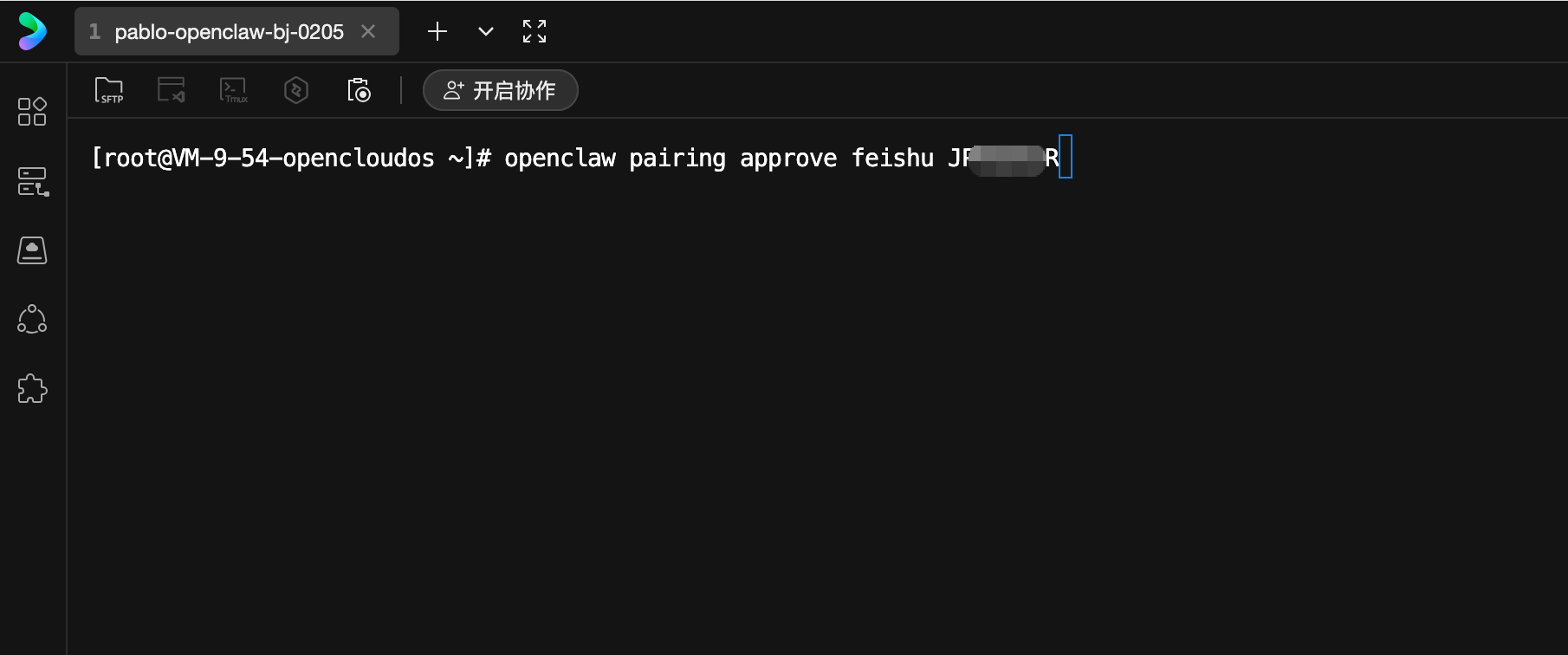

然后返回服务器后台,点击远程连接 进入终端,把最后一条openclaw pairing开头的口令粘贴在终端然后回车即可

到这里你的openclaw就已经连接上飞书了,你已经可以通过飞书机器人与你的openclaw进行沟通了,如果云服务器部署openclaw和对接飞书通道还有疑问可以看一下阿里云和腾讯云的官方文档

对接Nvidia开发者API

去英伟达开发者官网https://build.nvidia.com/注册账号,并登录到后台,然后它会叫你创建一个用户验证邮箱和手机号码,跟着流程走就好了

获取APIKEY

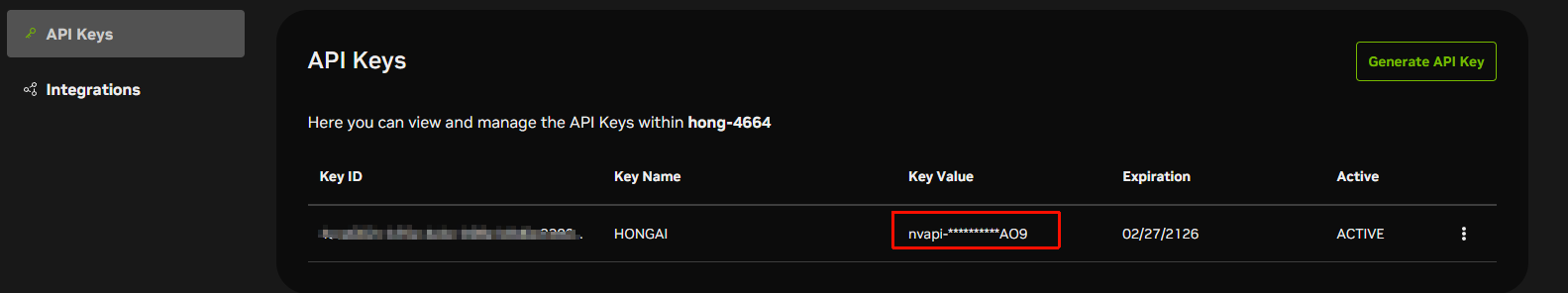

登录后点击右上角头像然后点击API Keys进入该页面,然后点击右上角按钮生成你的APIKEY,名称随意,然后根据自己喜好填写到期日期,最后点击生成按钮就好了,生成后的页面如下,生成后的apikey需要自己保存好,如果忘记了就重新生成就好了

获取模型配置

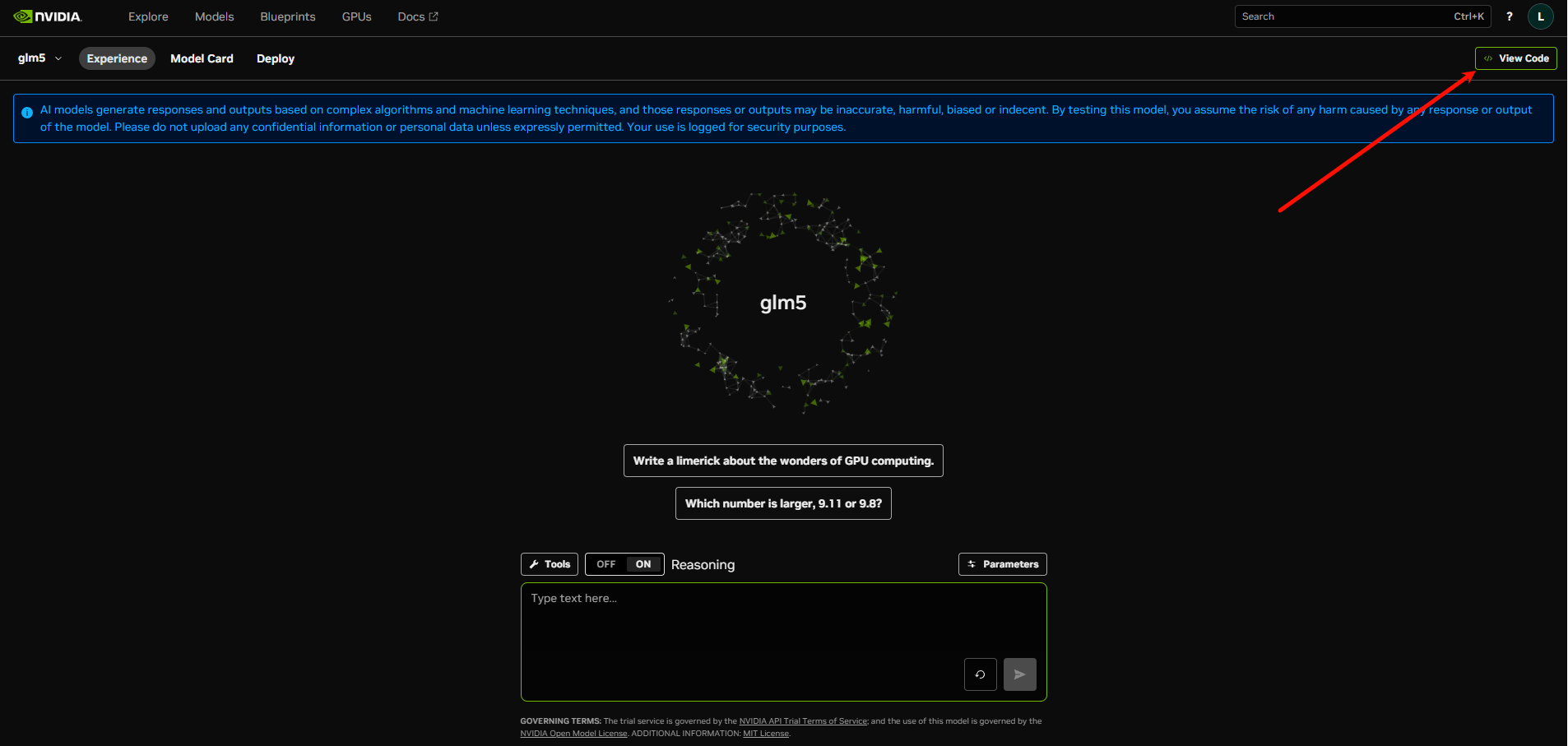

在模型界面选择你想要的模型,我以glm5模型为例,直接打开它

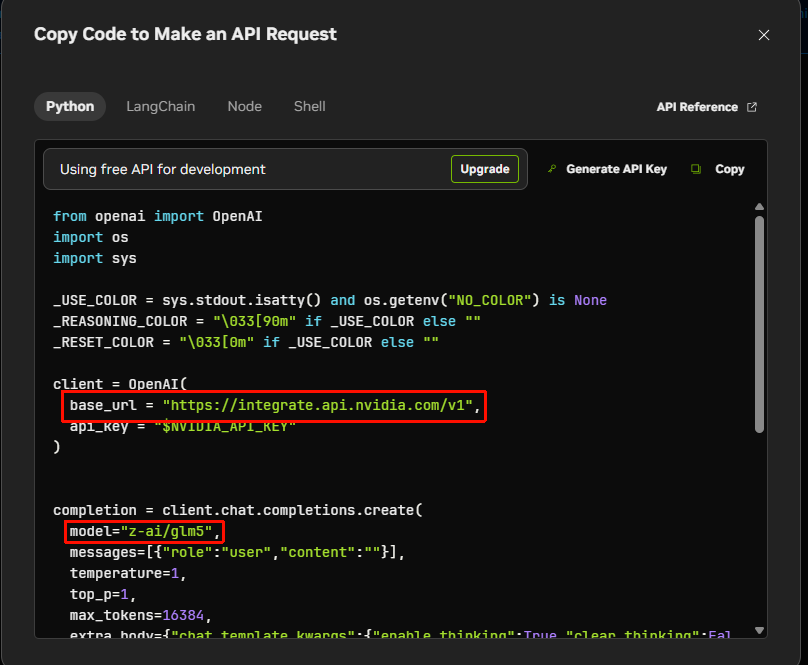

点击右上角的View Code按钮就会看到Nvidia提供的代码,在代码中找到base_url和model的配置,看下图我框选的位置

base_url基本不会变,一直就是https://integrate.api.nvidia.com/v1,我们要找的是模型ID,例如选择上图的GLM5那么模型ID就是z-ai/glm5

openclaw对接nvidia模型

nvidia的免费计划没有规定时间,也意味着官方可以随时取消或限制免费计划,早用早享受吧

如果是本地部署,或者直接按照openclaw官方一键命令安装的需要修改openclaw.json文件里面的模型配置,用下面代码替换文件中关于模型的配置,代码中的apikey和模型自己填你想接入的就好了

{

"provider": "nvidia",

"base_url": "https://integrate.api.nvidia.com/v1",

"api": "openai-completions",

"api_key": "这里填你的apikey",

"model": {

"id": "z-ai/glm5",

"name": "glm5"

}

}这几个数据的意义

provider:模型厂商名称base_url:连接模型厂商的地址api:这是api协议,填写openai-completions的就好api_key:模型厂商分配给你的密钥id:模型id就是前缀加上模型名称name:就是引用模型的名称(去除上面的前缀就是)

通过云服务器厂商一键部署的不用这么麻烦,在后台模型配置那里选择自定义模型然后输入在模型厂商获取到的配置,也就是上面在英伟达获取的配置,下图以腾讯云为例

点击添加并应用下方就会出现你刚才配置的模型已经在应用中了,到这里openclaw就对接好nvidia的模型了

博主在尝试用glm5会出现404所以大家最好不要用,还有一个情况是有的模型是比较慢的非常影响体验,可以先在英伟达开发者后台用前端尝试对话回复速度再决定使用,博主使用以来感觉效果最好的就是minimax-m2.5和step-3.5-flash,不仅响应速度快,效果也是杠杠的

openclaw常用命令

以下命令可以直接在对话中直接使用

🔍 基础信息类

/help显示帮助信息

/commands列出当前版本支持的所有命令

/status查看会话状态(连接状态、当前模型、Token 统计)

/settings查看或修改当前会话的设置(部分平台以菜单形式展示)

/usage <off|tokens|full>控制 Token 使用量的显示方式

💬 会话管理类

/new或

/reset重置当前会话,清空历史记录(最常用)

/abort中止 AI 正在生成的回复

/compact压缩会话历史,释放 Token 空间

/session 切换到指定会话(

key为会话标识符)

/sessions列出所有可用会话

/exit退出当前会话

🤖 模型与智能体类

/model <provider/model>切换 AI 模型(例如

/model minimax-m2.5)

/models列出所有可用模型

/agent 切换到指定智能体(预设角色或工作流)

/agents列出所有可用智能体

管理

pairing list列出所有待处理的配对请求(显示发送者信息和配对码)

openclaw pairing approve <配对码>批准指定配对码,将用户加入允许列表

总结

openclaw在众多大神的开发下出现了很多种玩法,它的功能要整合skill来变得更强,大家也可以在网上搜索openclaw的多种应用场景进行学习

随着时间的发展肯定 ai agent应用会越来越便捷和易用,但是不容置疑的是openclaw在AI Agent时代的洪流中,它立于浪尖之上,是最高、最猛的那一重惊涛

如果看了本篇文章还不会可以来博主的闲鱼店铺购买有偿服务-点击进入博主闲鱼店铺